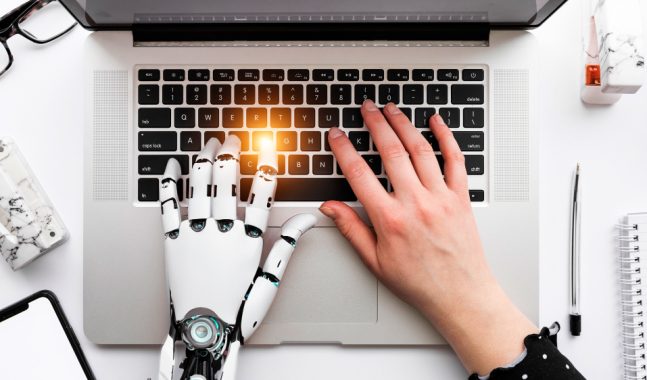

AI Act: voto finale per il primo regolamento globale sull’intelligenza artificiale

Di Agata Gueli

L’Europa, finalmente, ha varato il primo regolamento sull’intelligenza artificiale. Si tratta dell’ultima votazione di un lungo excursus, affinché il cosiddetto AI Act, diventi legge. Un’iniziativa unica che pone l’Europa come leader indiscussa sulla regolamentazione dell’intelligenza artificiale. Affinché il primo regolamento diventi esecutivo, bisogna che sia pubblicato in Gazzetta Ufficiale e che poi decorrano due anni di attuazione.

Riveste una particolare importanza, avere organizzato il complesso sistema di norme, attorno ad un nucleo fondante: la visione antropocentrica. La Segretaria Generale del Consiglio, Marija Pejinovi Buri, ha infatti ribadito quanto sarà importante l’uso dell’intelligenza artificiale per colmare le disuguaglianze, soprattutto quelle di genere e per prevenire le discriminazioni.

C’è chi però ritiene, che proprio su questo fronte, l’intelligenza artificiale potrà fare poco. La costituzionalista Ginevra Cerrina Feroni, Vicepresidente del garante per la privacy ritiene, infatti, che il testo sia invece carente dal punto di vista dei rischi connessi alle discriminazioni che possono derivare dall’uso di AI. Dopo il regolamento per la protezione dei dati (Gdpr) e il Digital Markets Act, l’Europa è la prima al mondo, a dettare regole e a fissare uno standard globale.

Questo regolamento si applicherà a tutti i paesi membri dell’Unione. Vengono proibite tutte quelle applicazioni che hanno un rischio, definito “inaccettabile”, come per esempio gli strumenti di polizia predittiva, i sistemi di riconoscimento delle emozioni in ambito lavorativo e scolastico, o i sistemi di categorizzazione biometrica che fanno riferimento a dati personali sensibili, come l’orientamento politico e sessuale o il credo religioso.

Un dato importante per quel che riguarda la manipolazione di notizie o immagini e che può interessare le fasce più fragili, è quello relativo all’introduzione di norme di contrasto alla manipolazione di immagini e contenuti audio o video artificiali o manipolati, i cosiddetti deepfake, che adesso dovranno essere etichettati in modo chiaro ed inequivocabile. Sull’uso poi dei modelli di intelligenza artificiale generativa, per intenderci ChatGPT, che è in grado di produrre testi e traduzioni in pochi secondi, si prevede che debbano essere trasparenti sulle fonti utilizzate e rispettare le norme sul diritto d’autore.

© RIPRODUZIONE RISERVATA

Solo gli utenti registrati possono commentare!

Effettua il Login o Registrati

oppure accedi via