IA generativa. L’ambivalenza del progresso tecnologico, da Prometeo al rischio estinzione

Il dibattito sulla bivalenza radicale di ogni progresso tecnologico, che presenta nello stesso tempo vantaggi e rischi, dura da sempre, forse fin da quando Prometeo rubò il fuoco agli Dei dell’Olimpo per regalarlo agli uomini, che lo posero al servizio delle loro scoperte in campo scientifico e tecnologico, nel bene e nel male. Lo stesso fuoco, che serviva per difendersi dal freddo e forgiare metalli domestici, fu subito usato anche per costruire lance e frecce e incendiare i villaggi degli avversari.

È sempre stato così, e lo sanno bene quei Paesi, a partire da quelli europei, che in età moderna hanno fondato la loro potenza economica e industriale sulla utilizzazione a fini militari delle scoperte scientifiche. Dalla polvere da sparo alla bomba atomica.

Ora siamo di nuovo di fronte a un dilemma: se lasciare o meno briglia sciolta alle ricerche e all’innovazione nel campo dell’Intelligenza Artificiale Generativa (IAG) e delle sue innumerevoli applicazioni in campo biologico e bioingegneristico, medico (telemedicina, chirurgia robotica), ma anche educativo (dagli assistenti digitali ai chip impiantabili nel cervello) e come sempre anche in quello militare (sistemi di difesa e offesa regolati da algoritmi).

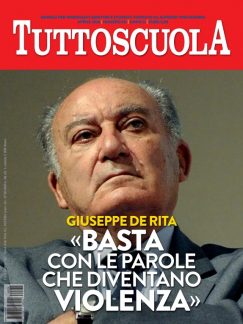

Solo che questa volta il dilemma potrebbe essere epocale, se non addirittura esistenziale. Geoffrey Hinton, premio Nobel 2024 per la fisica (insieme a John J. Hopfield) per le sue ricerche nell’ambito dell’apprendimento automatico con reti neurali artificiali, ispirate alla struttura delle reti di neuroni nel nostro cervello, ha avvertito, parlandone prima in un’intervista al New York Times, poi in un recente intervento nel programma Today di BBC Radio 4, che “c’è una probabilità del 10-20 per cento che entro i prossimi trent’anni l’Intelligenza Artificiale provochi l’estinzione dell’umanità”.

Geoffrey Hinton, 75 anni, nel 2023 si era licenziato da superconsulente di Google per poter liberamente denunciare i rischi delle macchine da lui stesso create. A suo giudizio la tecnologia sta avanzando “più velocemente del previsto”, e i chatbot, anche se per ora “non sono più intelligenti di noi, penso che presto potrebbero esserlo”. I software potrebbero essere strumentalizzati, deformati per raggiungere obiettivi pericolosi. In particolare, l’IA generativa potrebbe mettere a rischio la pluralità di pensiero, considerate le sue risposte simili e omologate dall’ideologia dominante: “il tipo di intelligenza che stiamo sviluppando è molto diverso dall’intelligenza che abbiamo. Noi siamo sistemi biologici, mentre questi sono sistemi digitali. E la grande differenza è che con i sistemi digitali hai molte copie dello stesso set, lo stesso modello del mondo”, e il rischio è quello di uniformare il pensiero attraverso risposte standard.

Che fare? Secondo Hinton, che ha presente soprattutto la realtà americana, occorre che il governo regolamenti l’IAG per legge: “Le aziende che la producono perseguono il profitto, non la sicurezza”. Per questo serve una legge che le obblighi a garantirla. Basterebbe? È permesso dubitarne: una legge made in USA varrebbe solo sul territorio americano. E il resto del mondo? Servirebbe una legge di portata planetaria, come intuì Immanuel Kant nel suo saggio Per la pace perpetua, scritto nel 1795 nel pieno delle guerre napoleoniche: solo un accordo internazionale all’insegna della razionalità, rispettato da tutti, può impedire che gli Stati si lascino andare alla loro storica tendenza naturale, che è quella a fare la guerra: quel bellum omnium contra omnes da quale si esce, aveva scritto Hobbes oltre un secolo prima, solo su basi contrattuali, giuridiche.

© RIPRODUZIONE RISERVATA

Solo gli utenti registrati possono commentare!

Effettua il Login o Registrati

oppure accedi via